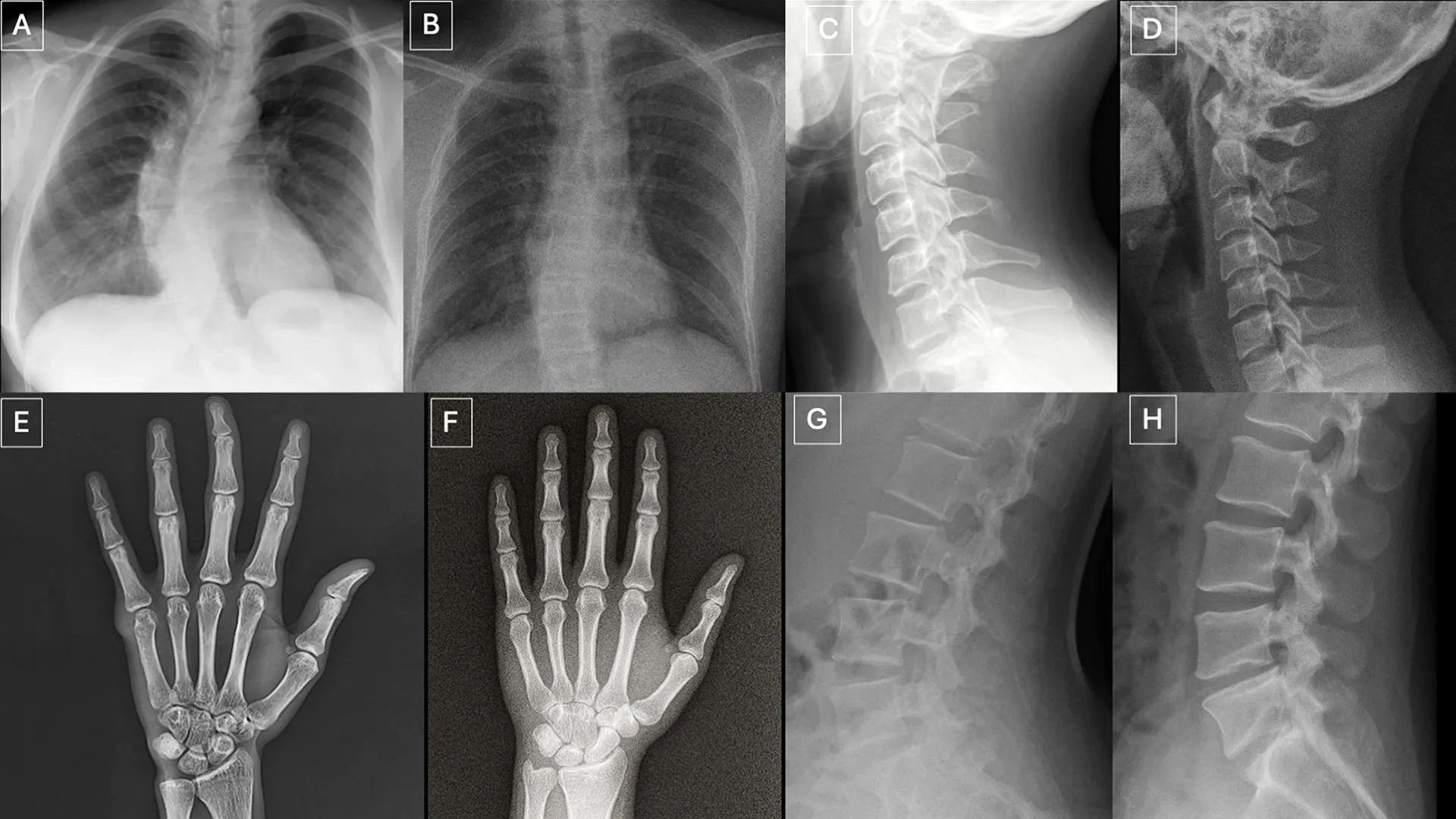

图源:The Rise of Deepfake Medical Imaging: Radiologists’ Diagnostic Accuracy in Detecting ChatGPT-generated Radiographs

好的牙·讯|2026年3月24日,发表于北美放射学会(RSNA)会刊《Radiology》期刊的一项研究显示,放射科医生及多模态大语言模型(LLMs)均难以分辨真实的X光片与AI生成的“深度伪造”图像。在未获知包含伪造图像的情况下,放射科医生识别AI生成的X光片准确率仅为41%。

该项研究由纽约西奈山伊坎医学院研究团队完成,共纳入了来自6个国家的12家机构的17名放射科医生,涵盖了从初学者到执业40年的资深专家。研究共测试了264张X光片,其中包括由ChatGPT生成的身体各部位影像,以及使用斯坦福大学开发的开源生成式AI扩散模型RoentGen生成的胸部影像。

实验数据显示,当医生被告知存在合成影像后,其平均识别准确率提升至75%。而在AI模型表现方面,GPT-4o、GPT-5、Gemini 2.5 Pro及Llama 4 Maverick的准确率在57%至85%之间。值得注意的是,尽管ChatGPT-4o表现优于其他模型,但作为图像生成工具的它,仍无法完全识别出所有由其生成的伪造影像。

研究人员指出,这些高度逼真的伪造影像不仅可能在虚假诉讼中作为证据,还存在严重的信息安全风险。若黑客侵入医院网络并注入合成影像,可能导致误诊并破坏数字病历的可靠性。目前,伪造影像在视觉上呈现出“过于完美”的特征,如骨骼过滑、脊柱异常笔直、血管分布过度均匀等,但在未来的AI演进中,这些特征可能进一步消失。

此前,好的牙曾报道韩国延世大学牙科学院实习课程中出现篡改X光片的学术造假事件:部分学生使用Photoshop修补或替换影像,以掩盖操作失误。彼时造假依赖人工,尚有痕迹可查。而本次发表于《Radiology》的研究进一步提示,在生成式AI介入后,伪造影像的逼真度可能持续上升,欺诈与误导的潜在风险随之扩大。

制度层面的应对同样滞后。根据好的牙此前报道,纽约州已拟立法禁止AI聊天机器人直接提供医疗建议,将AI风险纳入监管视野;但针对影像真实性的系统性保护机制,目前仍属空白。为此,研究建议医疗影像领域在图像捕获时嵌入不可见水印及加密签名,以验证来源真实性。

研究人员同样指出,该研究目前仍存在一定局限性:样本量相对较小且实验环境与真实临床场景存在差异,深度伪造技术在CT和MRI等3D影像中的影响仍有待进一步验证。

【特别鸣谢】如果本文有错漏之处需要勘误,请联系我们的客服,届时我们会为您准备小礼物,感谢!

【免责声明】上述内容源于公开信息,可能存在不准确性,仅供参考。本文不构成对任何人的投资与决策建议,好的牙不对因使用本资料而导致的损失承担任何责任,并对本内容拥有最终解释权。文中图片均已获版权方授权

@好的牙口腔行业研究